La inteligencia artificial generativa (IA) está transformando industrias con su capacidad para crear contenido nuevo en forma de texto, imágenes, música, sonidos y videos. Modelos de aprendizaje automático como la serie GPT de OpenAI destacan por su impresionante producción de texto y similitud con interacciones humanas. Sin embargo, esta tecnología poderosa también plantea riesgos, especialmente en el ámbito de la ciberseguridad.

Amenazas potenciales

- Malware avanzado y técnicas de evasión: La IA generativa puede ser usada maliciosamente para desarrollar malware sofisticado y difícil de detectar, ya que se adapta rápidamente a diferentes objetivos y entornos, eludiendo las medidas de seguridad tradicionales.

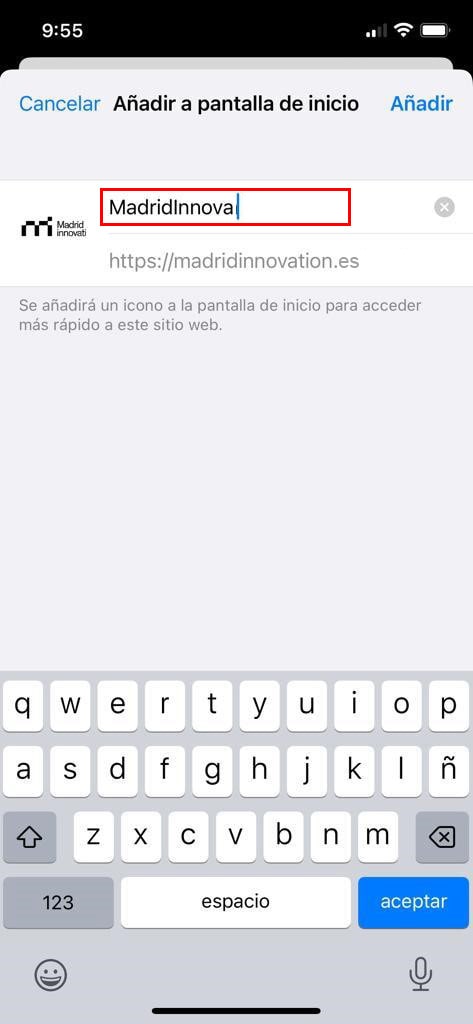

- Phishing, ingeniería social y suplantación de identidad: La capacidad de generar contenido convincente y personalizado podría aumentar el éxito de ataques de phishing e ingeniería social. La tecnología deepfake puede hacer pasar como real contenido de audio o video, lo que podría suponer un engaño y fraude para muchos usuarios desprevenidos, desinformados o demasiado confiados.

- Ingeniería inversa: La IA generativa podría automatizar y acelerar el proceso de ingeniería inversa, lo que podría ser beneficioso para investigadores de seguridad, pero también permitiría a actores maliciosos descubrir y explotar vulnerabilidades en sistemas.

- Omitir herramientas CAPTCHA: Los avances en IA han permitido desarrollar modelos que eluden eficazmente las herramientas CAPTCHA, poniendo en riesgo servicios en línea de ataques automatizados.

A medida que exploramos el potencial de esta tecnología, es vital priorizar las consideraciones éticas y proteger nuestro ecosistema digital.

Ante el aumento de amenazas producidas por IA, la industria de la ciberseguridad debe evolucionar rápidamente y adaptar sus estrategias. Es crucial invertir en investigación y desarrollo para implementar soluciones avanzadas que contrarresten los usos maliciosos de la IA y protejan nuestro entorno digital. El desarrollo de algoritmos de aprendizaje automático avanzados para detectar y responder a las amenazas generadas por IA es esencial.

La colaboración continua entre investigadores, expertos en seguridad cibernética, legisladores, fuerzas del orden y los sectores público y privado es clave para asegurar el uso responsable de la IA y construir defensas sólidas contra las cambiantes ciberamenazas.